13 listopada 2023

Safetica zabezpiecza korzystanie z ponad 200 narzędzi GenAI

Integracja narzędzi generatywnej sztucznej inteligencji ("GenAI") stała się normą w wielu branżach. Narzędzia te umożliwiają organizacjom usprawnienie procesów, poprawę wydajności i odblokowanie nowych ścieżek innowacji. Jednak wraz z potencjalnymi korzyściami pojawia się potrzeba nadzoru firm nad narzędziami AI wykorzystywanymi w ich środowisku.

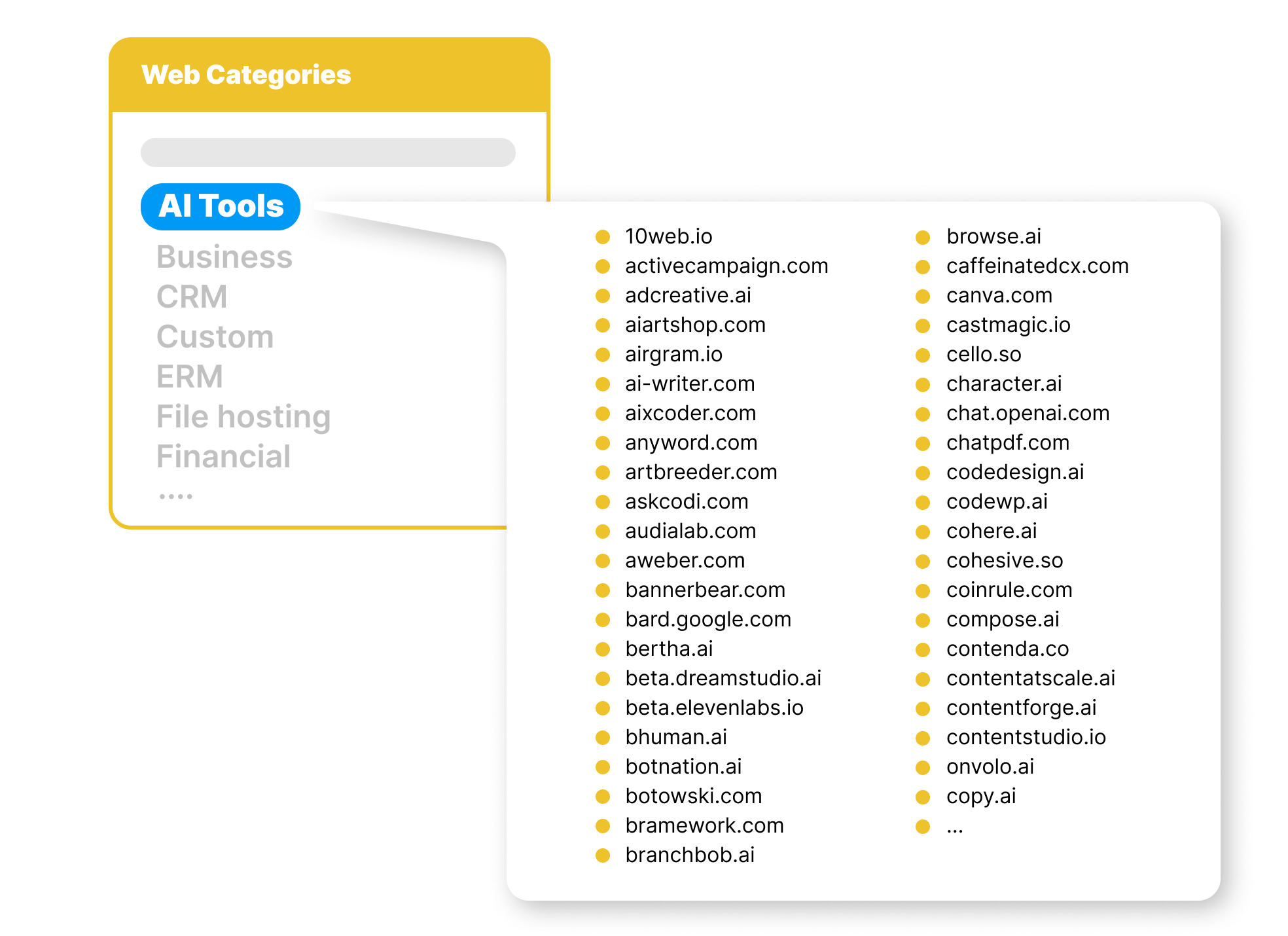

Safetica stosuje dwa podejścia do zarządzania wykorzystaniem narzędzi GenAI w organizacji. Podejścia te kategoryzują strony internetowe związane z narzędziami GenAI i zapewniają różne sposoby monitorowania i kontrolowania użycia.

Proaktywne blokowanie

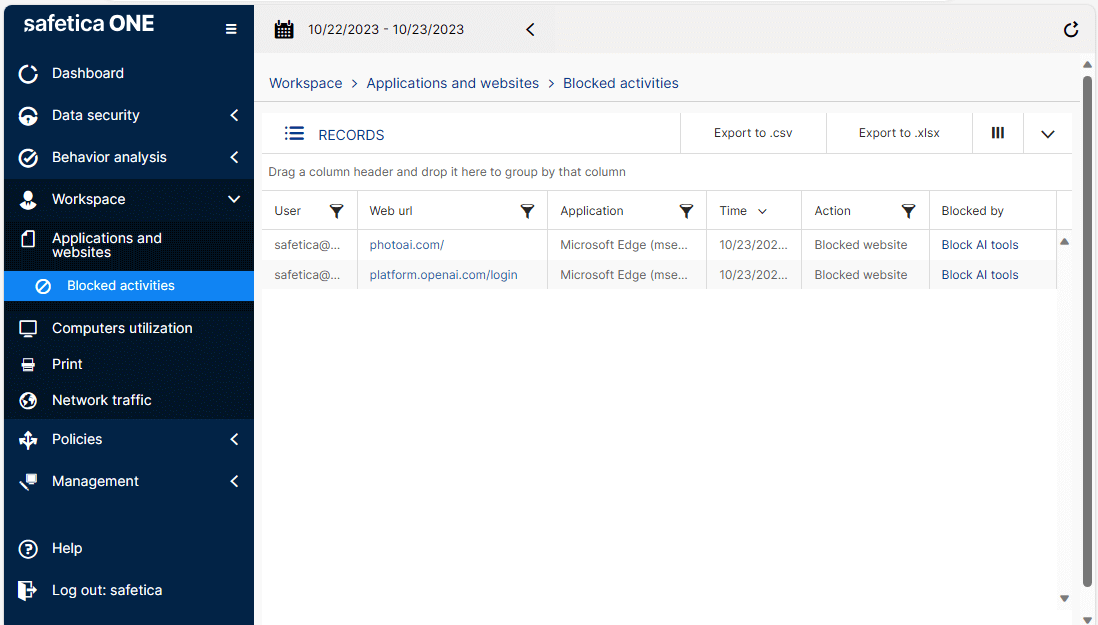

Safetica ONE przyjmuje proaktywną postawę w zarządzaniu wykorzystaniem narzędzi GenAI. Gdy użytkownik odwiedza stronę internetową skategoryzowaną jako narzędzie GenAI, natychmiast sygnalizuje, że narzędzie sztucznej inteligencji zostało wykorzystane w firmie. Ta przejrzystość pozwala organizacjom być na bieżąco z narzędziami swoich pracowników i promuje odpowiedzialne korzystanie z nich.

Co więcej, Safetica ONE może zablokować dostęp do tych stron internetowych za pomocą zaledwie kilku kliknięć. Jeśli firma uzna określone narzędzia GenAI za niezgodne z jej działalnością, może szybko ograniczyć dostęp, zapewniając zgodność z polityką bezpieczeństwa danych.

Ocena ryzyka i wgląd w zachowanie użytkowników

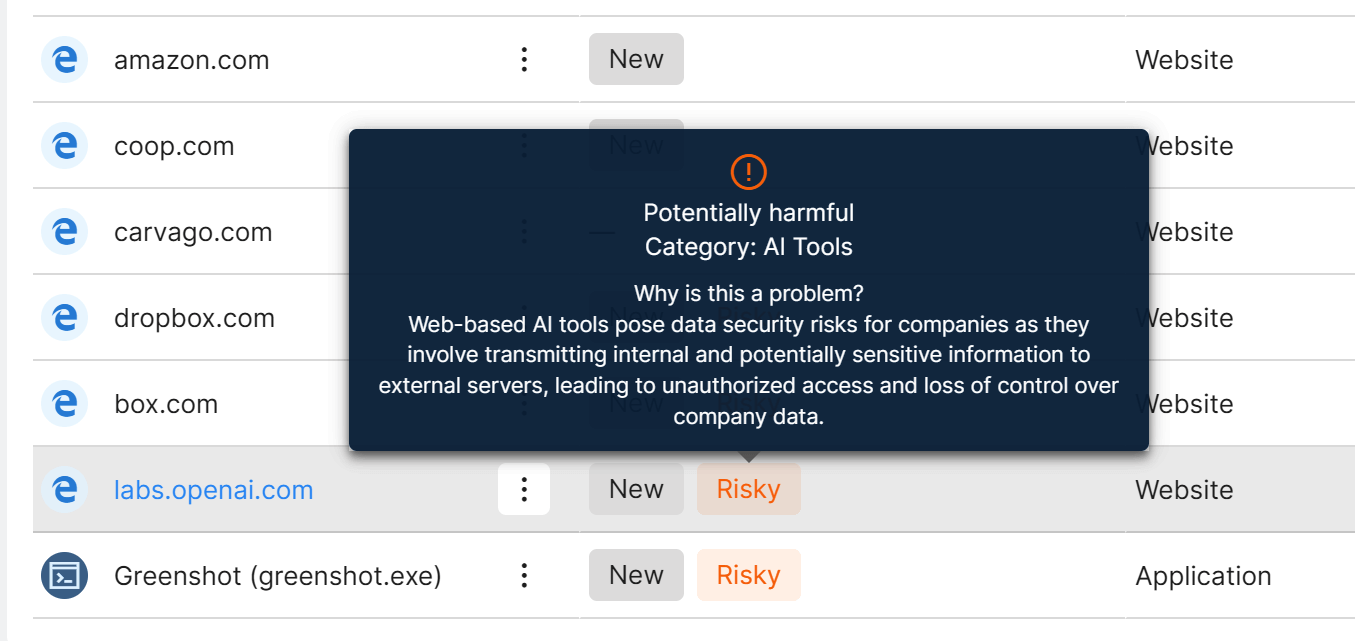

Safetica 11, DLP oparte na chmurze, przyjmuje bazujące na ryzyku podejście do zarządzania narzędziami GenAI. Uznaje, że odwiedzanie stron internetowych związanych z narzędziami GenAI może potencjalnie stanowić zagrożenie dla organizacji. Chociaż nie oferuje funkcji blokowania, którą cechuje się podejście proaktywne, wyróżnia się dostarczaniem szczegółowego wglądu w aktywność użytkowników w sieci.

Gdy pracownik odwiedza stronę internetową związaną z narzędziem GenAI, Safetica 11 identyfikuje ją jako ryzykowną aktywność w sieci. Ta kategoryzacja jest następnie wizualizowana jako problem w środowisku. System ten umożliwia organizacjom śledzenie potencjalnie ryzykownych zachowań, zapewniając podstawę do dalszych badań lub inicjatyw szkoleniowych.

Ponadto Safetica rozumie, że nie każde użycie narzędzia AI jest z natury szkodliwe. Rozróżnia rzeczywiste wykorzystanie do celów związanych z pracą od potencjalnych naruszeń bezpieczeństwa, co pozwala na indywidualne podejście do każdej sytuacji.

Skuteczne zarządzanie wykorzystaniem narzędzi AI w organizacji ma kluczowe znaczenie dla utrzymania bezpieczeństwa danych i zgodności z przepisami branżowymi. DLP oferuje różne podejścia i zapewnia firmom narzędzia do podejmowania świadomych decyzji dotyczących integracji rozwiązań GenAI.

Wykorzystując proaktywne blokowanie lub ocenę ryzyka i możliwości wizualizacji Safetica, organizacje mogą poprawić swój stan bezpieczeństwa danych i zapewnić odpowiedzialne korzystanie z narzędzi AI w miejscu pracy. Dzięki odpowiedniej strategii firmy mogą śmiało wykorzystać moc narzędzi GenAI, jednocześnie chroniąc poufne informacje.

Aby uzyskać więcej informacji o tym, jak Safetica może pomóc zmniejszyć ryzyko związane z narzędziami GenAI w Twojej organizacji, umów się na bezpłatną konsultację.

Mateusz Piątek

senior product manager Safetica / Holm Security / Segura

Masz pytania?

Skontaktuj się ze mną:

piatek.m@dagma.pl

532 570 255

Skuteczna ochrona przed wyciekiem danych

Polecane wydarzenia: